بقلم: نعوم تشومسكي، إيان روبرتس ، جيفري واتومول

ترجمة: كريم سعد

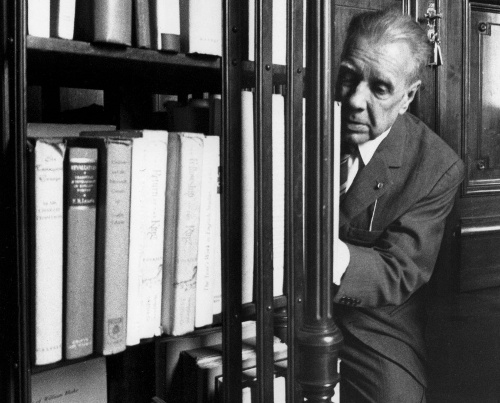

كتب خورخي لويس بورخيس في وقت ما أن العيش في “زمن الوعد والخطر العظيم” يجعلنا نختبر تجربة المأساة والكوميديا، وهذا ما ينطبق الأمر عليه الآن مع “اقتراب الكشف” عن فهمنا لأنفسنا والعالم. فاليوم، تطوراتنا الثورية المفترضة في الذكاء الاصطناعي هي في الواقع سبب للقلق والتفاؤل. التفاؤل لأن الذكاء هو الوسيلة التي نحل بها المشاكل. القلق لأننا نخشى أن النمط الأكثر شعبية وأناقة في الذكاء الاصطناعي – تعلم الآلة – سيؤدي إلى تدهور علمنا وتخفيض أخلاقياتنا من خلال إدماج تصورات معيبة جوهريا في اللغة والمعرفة في تكنولوجيتنا.

يعتبر شات جي بي تي من “أوبن إيه آي”، و”بارت” من “جوجل”، و”سيدني” من “مايكروسوفت”، أعجوبة في تعلم الآلة. بشكلٍ تقريبي، تأخذ هذه البرامج كميات هائلة من البيانات، وتبحث عن أنماط فيها، وتصبح أكثر كفاءة في إنتاج النتائج الإحصائية المحتملة – مثل اللغة والفكر المشابهين للإنسان. وقد استحسنت هذه البرامج باعتبارها الضوء الأول الخافت لأفق للذكاء الاصطناعي العام – تلك اللحظة المنتظرة منذ فترة طويلة حين تتجاوز العقول الميكانيكية العقول البشرية؛ ليس فقط من حيث الكمية من حيث سرعة المعالجة وحجم الذاكرة، ولكن أيضا من حيث الرؤية الفكرية والإبداع الفني وكل تأثير بشري مميز آخر.

قد يأتي ذلك اليوم، ولكن فجره لم يحل بعد، وهو عكس ما يمكن قراءته في عناوين مبالغ فيها ويتوقعه الاستثمار غير الحكيم. إن “الكشف البورخيسي” عن الفهم لم يحدث ولن يحدث، ونؤكد أنه لا يمكن أن يحدث إذا استمرت برامج التعلم الآلي مثل “شات جي بي تي” في السيطرة على مجال الذكاء الاصطناعي. فعلى الرغم من أن هذه البرامج يمكن أن تكون مفيدة في بعض المجالات الضيقة (فقد تساعد في برمجة الحاسوب، على سبيل المثال، أو في اقتراح القافية للشعر الخفيف)، إلا أننا نعلم من علم اللغة وفلسفة المعرفة أنها تختلف بشكل كبير عن كيفية تفكير الإنسان واستخدامه للغة، وتضع هذه الاختلافات قيودًا كبيرة على ما يمكن أن تفعله هذه البرامج، وتشفرها بعيوب لا يمكن القضاء عليها.

فهو مضحك ومأساوي في آن، كما كان بورخيس قد لاحظ، أن يركز الكثير من المال والاهتمام على شيء صغير جدًا – شيء تافه إذا ما قورن بالعقل البشري، الذي يمكنه، بفضل اللغة، كما يقول ويلهلم فون هومبولدت، الاستفادة “اللانهائية من الوسائل المحدودة”، مما يؤدي إلى خلق أفكار ونظريات تصل إلى كل مكان.

فالعقل البشري ليس، مثل “شات جي بي تي” وأمثاله، محركا إحصائيا ثقيلا لمطابقة الأنماط، والذي يتغذى على مئات التيرابايت من البيانات ويستنتج الإجابة الأكثر احتمالا على سؤال علمي أو استجابة حوارية. على العكس، العقل البشري نظام فعال ورشيق يعمل بكميات قليلة من المعلومات، فهو لا يسعى إلى استنتاج الارتباطات الخام بين نقاط البيانات، بل يسعى إلى إيجاد تفسيرات.

على سبيل المثال، فإن الطفل الصغير الذي يتعلم اللغة يطور نظام قواعد (قواعد نحوية)، وهو نظام متطور للغاية يعمل بمبادئ ومعايير منطقية. ويمكن فهم هذا النظام كتعبير عن النظام الأساسي الذي ثُبّتَ جينيا والذي يمنح الإنسان القدرة على إنشاء جمل معقدة وقطارات من الأفكار الطويلة. فعندما يسعى اللغويون إلى تطوير نظرية للغة حول سبب عمل اللغة بالطريقة التي تعمل بها (“لماذا يعتبر هذا النوع من الجمل صحيحًا، وليس ذاك؟”)، فإنهم يبنون نسخة واضحة ومفصلة من القواعد التي يبنيها الطفل بشكل غير مدرك وبدون الحاجة لكميات كبيرة من المعلومات. إن نظام الطفل الأساسي يختلف تماما عن نظام برنامج تعلم الآلة.

بالفعل، هذه البرامج عالقة في مرحلة ما قبل الإنسان أو غير الإنسانية من التطور الإدراكي. أعمق عيب لديهم هو غياب القدرة الأكثر حرجًا لأي ذكاء: أن تقول ليس فقط ما هو الحال، وما كان الحال، وما سيكون الحال – هذا هو الوصف والتنبؤ – ولكن أيضا ما ليس الحال وما يمكن أن يكون وما لا يمكن أن يكون. هذه هي مكونات التفسير، علامة الذكاء الحقيقي.

هنا مثال. لنفترض أنك تحمل تفاحة في يدك. الآن تترك التفاحة. تلاحظ النتيجة وتقول: “التفاحة تسقط”. هذا هو الوصف. وقد يكون التنبؤ بيانًا مثل “سوف تسقط التفاحة إذا فتحت يدي”. كلاهما قيم، وكلاهما يمكن أن يكون صحيحًا. ولكن التفسير هو شيء أكثر: يتضمن ليس فقط الوصف والتنبؤات، بل يشمل أيضا الاحتمالات الفرضية العكسية مثل “سوف يسقط أي كائن مشابه”، بالإضافة إلى الجملة الإضافية “بسبب قوة الجاذبية” أو “بسبب انحناء الزمكان” أو أي شيء آخر. هذا هو التفسير السببي: “لم يكن من الممكن أن تسقط التفاحة إلا بفعل قوة الجاذبية”. هذا هو التفكير.

جوهر تعلّم الآلة هو الوصف والتنبؤ، ولا يفترض أي آلية سببية أو قوانين فيزيائية. بالطبع، لا يعني ذلك أن أي تفسير بنمط الإنسان صحيح دائمًا، فنحن عرضة للخطأ. ولكن هذا يجعل جزءًا من ما يعني التفكير: أن تكون صحيحًا، يعني أنه يجب أن يكون من الممكن أن تكون مُخطئًا، فالذكاء لا يتألف فقط من التخمينات الإبداعية ولكن أيضا من الانتقادات الإبداعية. ويستند تفكير الإنسان على التفسيرات الممكنة وتصحيح الأخطاء، وهي عملية تحدّد تدريجيًا ما الذي يمكن النظر فيه بشكل منطقي. (كما قال شيرلوك هولمز للدكتور واطسون: “عندما تستبعد كل ما هو مستحيل، فإن ما يبقى، مهما كان مستبعدا، لا بد أن يكون الحقيقة”).

ولكن برامج مثل “شات جي بي تي” صممت لتكون غير محدودة فيما يمكنها “تعلمه” (أي حفظه)، وهي غير قادرة على التمييز بين الممكن والمستحيل. بشكل عام، تتعلم هذه البرامج اللغات التي يمكن للبشر تعلمها وكذلك اللغات التي يعتبرها البشر مستحيلة بالتساوي. بينما يقتصر البشر في أنواع التفسيرات التي يمكننا التكهن بها بشكل عقلاني، يمكن لنظم التعلم الآلي تعلم أن الأرض مسطحة وأن الأرض كروية. وهي تتاجر فقط في الاحتمالات التي تتغير مع مرور الوقت.

لهذا السبب، ستكون توقعات أنظمة التعلم الآلي دائمًا سطحية ومشكوك فيها. لأن هذه البرامج لا يمكنها تفسير قواعد صياغة اللغة الإنجليزية، على سبيل المثال، قد تتنبأ بشكل خاطئ بأن “جون عنيد جدًا ويتعذر التحدث معه” بمعنى أن جون عنيد جدًا حتى أنه لن يتحدث إلى أي شخص (بدلاً من أنه عنيد جدًا لدرجة أنه لا يمكن التفاوض معه). لماذا ستتنبأ برامج التعلم الآلي بشيء مثل هذا؟ لأنه قد يجري تنسيق النمط الذي استنتجه من الجمل مثل “جون أكل تفاحة” و “جون أكل”، يعني هذا في الأخير بأن جون أكل شيئًا ما.

وقد يتوقع البرنامج بشكل صحيح أن “جون عنيد جدًا ليتحدث مع بيل” مشابهًا لـ”جون أكل تفاحة”، ويفترض بناء على ذلك أن “جون عنيد جدًا ويتعذر التحدث معه” يجب أن يكون مشابهًا لـ “جون أكل”. إن تفسيرات اللغة الصحيحة معقدة ولا يمكن تعلمها فقط عن طريق التشبع بالبيانات الضخمة.

بشكل معاكس، يبدو بعض عشاق تعلّم الآلة فخورين بأنّ إبداعاتهم يمكنها توليد تنبؤات “علمية” صحيحة (على سبيل المثال، حول حركة الأجسام الفيزيائية) دون الاعتماد على التفسيرات (التي تشمل، على سبيل المثال، قوانين نيوتن للحركة والجاذبية العامة). ومع ذلك، هذا النوع من التنبؤات، حتى عندما تكون ناجحة، هو علم زائف. بينما يسعى العلماء بالتأكيد على النظريات التي تتمتّع بدرجة عالية من التأكيد الإمبراطوري، كما لفت الفيلسوف كارل بوبر الانتباه لهذا الأمر بقوله، “نحن لا نسعى لنظريات ذات احتمالية عالية ولكن إلى التفسيرات؛ وهذا يعني النظريات القوية وذات الاحتمالية العالية”.

النظرية التي تقول إن التفاح يسقط على الأرض لأن ذلك هو مكانه الطبيعي (وجهة نظر أرسطو) ممكنة، ولكنها تدعو فقط للمزيد من الأسئلة. (لماذا هو مكانه الطبيعي؟) النظرية التي تقول إن التفاح يسقط على الأرض لأن الكتلة تحني الفضاء-الزمن (وجهة نظر أينشتاين) ذات احتمالية عالية، ولكنها في الواقع تخبرك لماذا يسقط. ويظهر الذكاء الحقيقي هنا في القدرة على التفكير والتعبير عن الأشياء اللا محتملة ولكن الرائعة.

فالذكاء الحقيقي هو القادر أيضًا على التفكير الأخلاقي. وهذا يعني تقييد الإبداع اللامحدود لعقولنا بمجموعة من المبادئ الأخلاقية التي تحدد ما يجب وما لا يجب (وبالطبع تعريض تلك المبادئ نفسها للنقد الإبداعي). ليكون مفيدًا، يجب أن يتمكن “شات جي بي تي” من توليد مخرجات تبدو جديدة ؛ ليكون مقبولا لمعظم مستخدميه، ويجب أن يبتعد عن المحتوى الأخلاقي المرفوض. لكن مبرمجي “شات جي بي تي” وغيرهم من عجائب التعلم الآلي قد تعثروا – وسيستمرون في التعثر – في تحقيق هذا النوع من التوازن.

في عام 2016، غمر “تاي شات بوت” الخاصة بشركة مايكروسوفت (تجربة سابقة لـ “شات جي بي تي”) الإنترنت بالمحتوى المناهض للمرأة والعنصرية، بعد أن احتلت من قبل المتحرشين عبر الإنترنت الذين ملئوه بالبيانات التدريبية المسيئة. والسؤال الآن كيف يمكن حل المشكلة في المستقبل؟ في غياب القدرة على الاستدلال من المبادئ الأخلاقية، وقيّد “شات جي بي تي” بشكل خشن من قبل مبرمجيه في المساهمة بأي شيء جديد في المناقشات الجدلية، أي في المواضيع المهمة. فقد تضحّى بالإبداع من أجل نوع من اللاأخلاقية.

ملحوظة، بالرغم من الفكر واللغة المبدعة الواضحة، فإن اللامبالاة الأخلاقية تنبثق عن عدم الذكاء. وهنا، يُظهر “شات جي بي تي” شيئًا يشبه عفوية الشر: الاقتباس واللامبالاة والتجاهل. إنه يلخص الحجج القياسية في الأدبيات بنوع من التعبئة الذاتية الفائقة، ويرفض التعهد بأي شيء، ويستند ليس فقط على الجهل ولكن على نقص الذكاء، ويقدم في النهاية دفاعًا عن نفسه بأنه “يتبع الأوامر فقط”، وينقل المسئولية إلى مبتكريه.

باختصار، فإن “شات جي بي تي” وأقرانه غير قادرين على توازن الإبداع مع القيود. إما أن يُنتجوا كميات زائدة (من إنتاج الحقائق والأكاذيب، ودعم القرارات الأخلاقية وغير الأخلاقية على حد سواء) أو يتجاهلوا (يظهرون عدم الالتزام بأي قرارات ولامبالاة تجاه النتائج) ما يُظهر الاستحالة الأخلاقية والعلم الزائف والعجز اللغوي لهذه الأنظمة. وإننا لا نستطيع إلا الضحك أو البكاء على شعبيتها.