كتب: NBC news

ترجمة وعرض: تامر الهلالي

في صيف عام 2019، اشترك مستخدم جديد على “فيسبوك” باسم “كارول سميث” في المنصة ، واصفة نفسها بأنها أم محافظة سياسيا من “ويلمنجتون” بولاية “نورث كارولينا”.

أشار حساب سميث إلى الاهتمام بالسياسة والأبوة والمسيحية وتابعت عددا قليلاً من علاماتها المفضلة، بما في ذلك شبكة “”Fox News والرئيس آنذاك “دونالد ترامب”.

على الرغم من أن “سميث” لم تعرب أبدا عن اهتمامها بنظريات المؤامرة، ففي غضون يومين فقط أوصى فيسبوك حسابها بالانضمام إلى مجموعات محسوبة على جماعة “Qanon” وهي نظرية وحركة مؤامرة مترامية الأطراف لا أساس لقناعاتها من الصحة، حيث ادعت أن “ترامب” كان ينقذ العالم سرا من عصابة من المشتهين بالأطفال والشيطان.

لم تتبع “سميث” مجموعات “”QAnon المُوصَى بها، ولكن مهما كانت الخوارزمية التي استخدمها “فيسبوك” لتحديد كيفية تفاعلها مع النظام الأساسي، فقد تم المضي قُدما بنفس الطريقة. في غضون أسبوع واحد، امتلأ شريطها الإخباري “news feed” بالمجموعات والصفحات التي انتهكت قواعد “فيسبوك” الخاصة، بما في ذلك تلك المناهضة لخطاب الكراهية والمعلومات المضللة.

لم تكن “سميث” شخصا حقيقيا؛ فقد اخترع باحث يعمل لدى “فيسبوك” الحساب، جنبا إلى جنب مع غيره من “المستخدمين المختبرين” الوهميين في 2019 و 2020، كجزء من تجربة في دراسة دور النظام الأساسي في تضليل المستخدمين واستقطابهم من خلال أنظمة التوصيات الخاصة به.

قال ذلك الباحث إن تجربة “سميث” على “فيسبوك” كانت “وابلا من المحتوى المتطرف والتآمري والصور”.

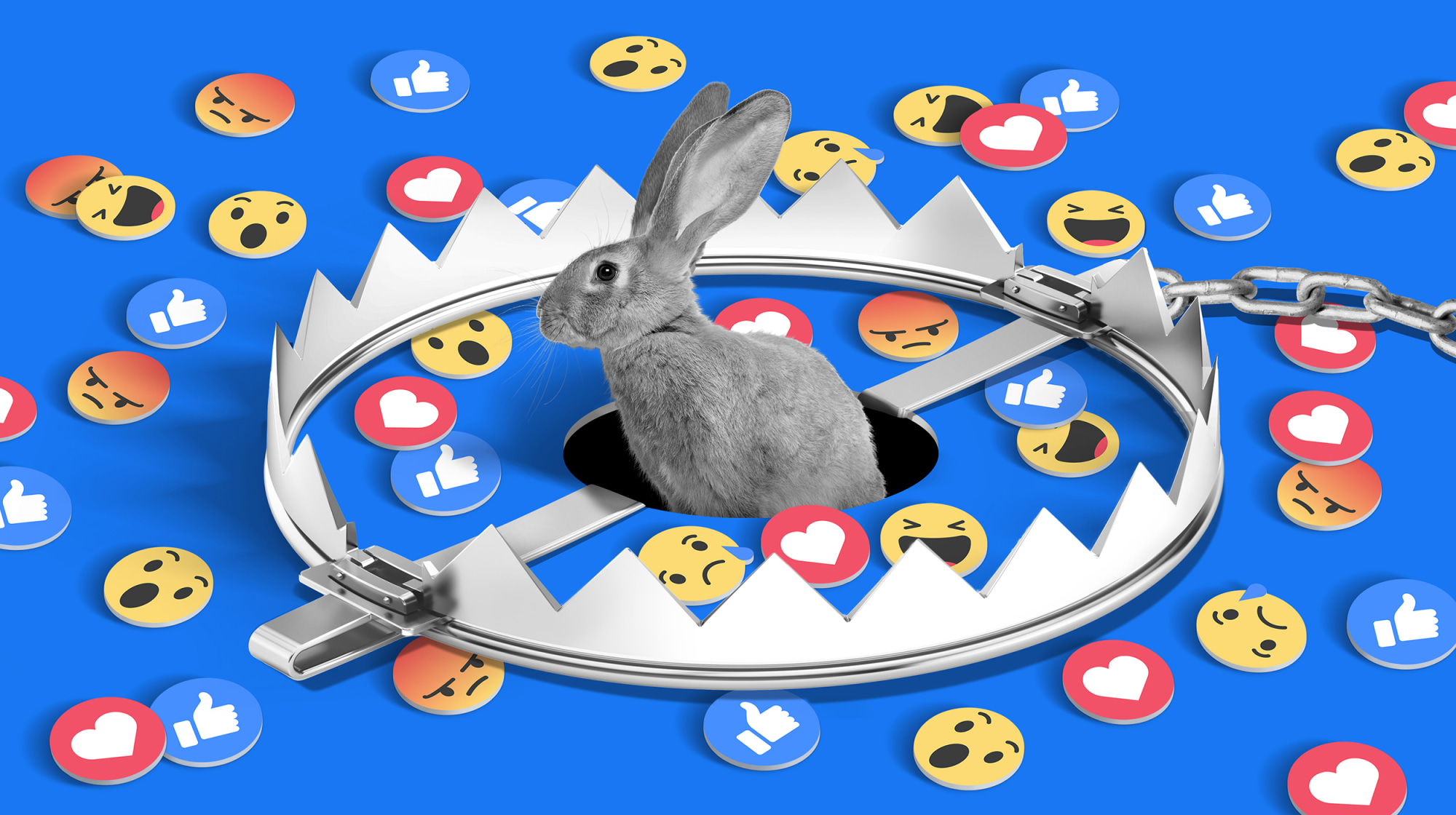

وجدت مجموعة الأبحاث باستمرار أن “فيسبوك” دفع بعض المستخدمين إلى “ثقوب الأرانب” وهي غرف صدى ضيقة بشكل متزايد؛ حيث تزدهر نظريات المؤامرة العنيفة. ويشكل الأشخاص الذين تحولوا إلى التطرف من خلال “ثقوب الأرانب” شريحة صغيرة من إجمالي المستخدمين، ولكن على نطاق “فيسبوك” يمكن أن يعني ذلك ملايين الأفراد.

كانت النتائج التي تم الإبلاغ عنها في تقرير بعنوان “رحلة كارول” إلى “QAnon”، من بين آلاف الصفحات من المستندات التي تم الإفصاح عنها إلى لجنة الأوراق المالية والبورصات والتي تم تقديمها إلى الكونغرس في شكل منقح من قبل المستشار القانوني لـ “فرانسيس هوجن” التي عملت مدير إنتاج في “فيسبوك” حتى مايو.

كانت “هوجن” قد أكدت أن فيسبوك يجني أرباحا على حساب السلامة العامة، في وقت سابق من هذا الشهر، وأدلت بشهادتها حول ادعاءاتها أمام لجنة فرعية بمجلس الشيوخ.. وكانت بلاغات عن العديد من المخالفات قد قُدمت، وشكاوى محددة بهذا الشأن.

تمت مشاركة إصدارات عمليات الكشف التي نقحت أسماء الباحثين، بما في ذلك مؤلف “رحلة كارول إلى QAnon” رقميا ومراجعتها من قبل اتحاد من المؤسسات الإخبارية، بما في ذلك شبكة “NBC News” كما نشرت صحيفة وول ستريت جورنال الشهر الماضي سلسلة من التقارير تستند إلى العديد من الوثائق في ذات الموضوع.

وفي رد على أسئلة عبر البريد الإلكتروني قال متحدث باسم “فيسبوك”: “بينما كانت هذه دراسة لمستخدم افتراضي واحد، إلا أنَّها مثال ممتاز للبحث الذي تقوم به الشركة لتحسين أنظمتنا وقد ساعدت الدراسة في اتخاذنا قرارا بإزالة “”QAnon من المنصة”.

من بين ما كشفت عنه “هوجن” مجموعة من الأبحاث والتقارير والمنشورات الداخلية التي تشير إلى أن “فيسبوك” قد عرف منذ فترة طويلة أن خوارزمياته وأنظمة التوصيات الخاصة به تدفع بعض المستخدمين إلى التطرف. وفي حين تجاهل بعض المديرين والمديرين التنفيذيين التحذيرات الداخلية؛ استغلتها المجموعات المناهضة للقاحات وحركات نظرية المؤامرة ووكلاء التضليل الإعلامي، ما كان من شأنه تهديد الصحة العامة والسلامة الشخصية والديمقراطية بشكل عام.

تؤكد هذه الوثائق بشكل فعال ما كان يردده باحثون خارجيون لسنوات سابقة، وترفضه إدارة “فيسبوك” ومنهم “رينيه ديريستا” مدير الأبحاث التقنية في مرصد “ستانفورد” للإنترنت وأحد أوائل من حذروا من بوادر مخاطر التوصيات الخوارزمية لـ “فيسبوك”.

يُظهر بحث “فيسبوك” مدى سهولة تمكن مجموعة صغيرة نسبيا من المستخدمين من اختراق النظام الأساسي، وبالنسبة لـ “ديريستا” فإنه يحسم أي سؤال متبقي حول دور “فيسبوك” في تنامي شبكات المؤامرة.. إذ قال: “فيسبوك حرفياً ساعد في تسهيل هذا التنامي”.

نمط فيسبوكي

لسنوات كان باحثو الشركة يجرون تجارب مثل تجربة “كارول سميث” لقياس دور النظام الأساسي في جعل المستخدمين متطرفين، وفقًا للوثائق التي اطلعت عليها “NBC News”.

وقد وجد هذا العمل الداخلي مرارا وتكرارا أنَّ أدوات التوصية دفعت المستخدمين إلى الجماعات المتطرفة، والنتائج التي ساعدت في إعلام تغييرات السياسة، وتعديل التوصيات وتصنيفات الأخبار. هذه التصنيفات عبارة عن نظام دائم التطور، يُعرف على نطاق واسع باسم “الخوارزمية” التي تدفع المحتوى إلى المستخدمين. لكن البحث في ذلك الوقت لم يكن كافيا لإلهام أي حركة لتغيير المجموعات والصفحات نفسها.

وقالت “هوجن” للصحفيين هذا الشهر: “إن هذا التردد كان مؤشرا على نمط في “فيسبوك” يريدون به إيجاد أقصر طريق بين سياساتهم الحالية وأي إجراء”.

وأضافت “هوجن”: “هناك تردد كبير في حل المشكلات بشكل استباقي”.

وقد شكَّك متحدث باسم “فيسبوك” في أن البحث لم يدفع الشركة إلى التصرف؛ وأشار إلى أن التغييرات التي طرأت على المجموعات التي تم الإعلان عنها كان في مارس.

وبالنسبة للعديد من الموظفين داخل “فيسبوك” فقد جاء التنفيذ بعد فوات الأوان، وفقا للمنشورات التي تُركت على لوحة الرسائل الداخلية للشركة.

وفي منشور كتيه أحد باحثي النزاهة –تم حذف اسمه– أعلن فيه أنه سيغادر الشركة، معللا ذلك بقوله: “لقد عرفنا منذ أكثر من عام أن أنظمة التوصية لدينا يمكن أن تقود المستخدمين بسرعة كبيرة في طريق إلى نظريات المؤامرة والمجموعات المتطرفة، وقد نمت هذه المجموعة الهامشية ووصلت إلى مكانة بارزة على المستوى الوطني، مع وجود مرشحي ” Qanon” للكونغرس. لقد كنا على استعداد للعمل فقط بعد تصاعد الأمور إلى حالة يرثى لها”.

وبينما بدا حظر “فيسبوك” فعالا في البداية، فقد ظلت هناك مشكلة إزالة المجموعات وتلك الصفحات.. ولم يقض ذلك على أكثر أتباع “Qanon” تطرفا؛ إذ استمروا في العمل من خلال المنصة.

مناهضة اللقاحات

قال “مارك أندريه أرجنتينو” الزميل الباحث في المركز الدولي لدراسة التطرف في “كينجز كوليدج لندن” “كان هناك أدلة كافية لرفع الأعلام الحمراء في مجتمع الخبراء على أن “فيسبوك” والمنصات الأخرى فشلت في معالجة البعد المتطرف العنيف لـ “Qanon”.

ببساطة أعاد الأتباع تسميتهم كمجموعات مناهضة للإتجار بالأطفال أو هاجروا إلى مجتمعات أخرى، بما في ذلك تلك الموجودة حول حركة مناهضة اللقاحات.

ووجد الباحثون داخل “فيسبوك” الذين يدرسون المجتمعات المتخصصة بالمنصة أن المعتقدات التآمرية العنيفة مرتبطة بالتردد حيال لقاح Covid”-19″.

وفي إحدى الدراسات وجد الباحثون أن أفراد مجتمع “Qanon” كانوا أيضا مركزين بشكل كبير في المجتمعات المضادة للقاحات. وبالمثل استغل المؤثرون المناهضون للقاحات فرصة انتشار الوباء واستخدموا ميزات “فيسبوك” مثل المجموعات والبث المباشر؛ لتنمية تحركاتهم.

وأشار باحثون إلى أنهم : “لا يعرفون ما إذا كان “Qanon” قد خلق الشروط المسبقة لمعتقدات رفض تلقي اللقاح.. هذا ليس مهما في كلتا الحالتين فالمهم هو الاهتمام بالأشخاص المتأثرين بكلتا المشكلتين”.

تحالف جديد

قفز اتباع “Qanon” أيضا إلى الجماعات التي تروج للادعاء الكاذب للرئيس السابق “دونالد ترامب” بأن انتخابات عام 2020 قد سُرقت، وهي مجموعات روجت لخليط من نظريات المؤامرة التي لا أساس لها والتي تزعم أن الناخبين والديمقراطيين ومسئولي الانتخابات كانوا يخدعون “ترامب” بطريقة ما خارج فترة ولاية ثانية.

هذا التحالف الجديد الذي تم تنظيمه إلى حد كبير على “فيسبوك” اقتحم في نهاية المطاف مبنى الكابيتول الأمريكي في 6 يناير الماضي، وفقًا لتقرير مدرج في الوثيقة الدفينة وأبلغ عنه لأول مرة موقع BuzzFeed” News” في أبريل الماضي.

وقد أصبحت مجموعات المؤامرة هذه هي المجموعات الأسرع نموا على “فيسبوك” وفقا للتقرير، لكن “فيسبوك” لم يكن قادرا على التحكم في “نموها النيزكي”، كما كتب باحثون “…لأننا كنا ننظر إلى كل كيان على حدة، بدلا من التعامل معها كحركة متماسكة”.

وقد أخبر متحدث باسم “فيسبوك” موقع “BuzzFeed News” أن الأمر قد صدر باتخاذ العديد من الخطوات التي من شأنها الحد من تدفق المعلومات المضللة عن الانتخابات؛ لكن الأمر بات صعبا في ظل عدم التمكن من معرفة كل شيء بهذا الخصوص.

وكتب فريق الباحثين في “فيسبوك” أن التطبيق كان يعمل جزئيا على بناء أدوات وبروتوكولات وإجراء مناقشات حول سياسة تساعد على القيام بذلك بشكل أفضل في المرة القادمة”.

“مشكلة ثقيلة الرأس”

حرض الهجوم على مبنى الكابيتول الموظفين على التفكير الذاتي القاسي.

استند أحد الفريقين إلى الدروس المستفادة خلال لحظة “Qanon” للتحذير من السماح بمجموعات ومحتوى مضاد للقاحات، والذي وجد الباحثون أنه يشتمل على ما يصل إلى نصف جميع مرات ظهور محتوى اللقاح على المنصة.

قال التقرير: “في المواقف سريعة التطور، غالبا ما نتخذ الحد الأدنى من الإجراءات في البداية بسبب مجموعة من السياسات والقيود المفروضة على المنتج، ما يجعل من الصعب للغاية تصميم التدخلات الجديدة والحصول على الموافقة عليها وطرحها بسرعة”. تم تقديم “Qanon” كمثال على الوقت الذي كان فيه فيسبوك “مدفوعا بالاحتجاج المجتمعي على الأضرار الناتجة عن تنفيذ عمليات إزالة الكيانات” لأزمة “اتخذنا فيها في البداية إجراءً محدودا أو بدون أي إجراء”.

كما أدت الجهود المبذولة لإلغاء الانتخابات إلى تنشيط الجهود لتنظيف المنصة بطريقة أكثر استباقية.

وقد شكَّل فريق “المحتوى الخطير” في “فيسبوك” مجموعة عمل في أوائل عام 2021، لاكتشاف طرق للتعامل مع نوع المستخدمين الذين كانوا يمثلون تحديا لـ “فيسبوك” : مثل مجتمعات “”QAnon و منكري كوفيد وحركة “incel” المعادية للمرأة والتي لم تظهر كراهية واضحة، والجماعات الإرهابية ولكن ذلك بطبيعته قد شكَّل خطرا على سلامة الأفراد والمجتمعات.

لم يكن التركيز بهدف القضاء على هذه المجموعات، ولكن للحد من نموها بوصفها “مجتمعات الموضوعات الضارة” ذات الأسماء والتعريفات الجديدة، باستخدام نفس الأدوات الخوارزمية التي سمحت لها بالخروج عن نطاق السيطرة.

وقد كتب الفريق في تقرير 2021، ما يفيد بأنهم “يعرفون كيفية اكتشاف وإزالة المحتوى الضار والجهات العدائية والشبكات الخبيثة المنسقة، لكنهم لم يفهموا بعد الأضرار الإضافية المرتبطة بتكوين المجتمعات الضارة، وكذلك كيفية التعامل معها “.

وقد قام مبدعو فريق النزاهة بتصميم نظام داخلي يهدف إلى قياس وحماية المستخدمين من الأضرار المجتمعية بما في ذلك التطرف والاستقطاب والتمييز التي ساعدت أنظمة التوصية الخاصة بالمنصة في إحداثها.. وقد ورد ذلك في تقرير شهر فبراير الماضي. كان ذلك بناءً على جهد بحثي سابق أطلق عليه اسم “مشروع رابيثول” وقد أطلق على البرنامج الجديد اسم “Drebbel” نسبة إلى “كورنيليس دريبل” وهو مهندس هولندي عاش في القرن السابع عشر وعُرف باختراعه أول غواصة صالحة للملاحة وأول ترموستات.

تم تكليف مجموعة Drebbel باكتشاف وإيقاف المسارات التي تحرك المستخدمين نحو المحتوى الضار على “فيسبوك” و “انستغرام” بما في ذلك مجموعات مكافحة اللقاحات و Qanon””.

وأشاد منشور من فريق Drebbel بالبحث السابق حول مستخدمي الاختبار.. وكتبوا “نعتقد أن “دريبل” سيكون قادرا على توسيع نطاق هذا بشكل كبير”.

وقد صرحت المجموعة في منشور داخل مبنى الشركة على لوحة الرسائل الداخلية قائلة: “يمكن أن تكون عمليات الانضمام إلى المجموعة إشارة مهمة ومسارا للأشخاص الذين يتجهون نحو المجتمعات الضارة والمدمرة.. ويمكن أن يؤدي تعطيل هذا المسار إلى منع المزيد من الضرر”.

وتعمل مجموعة Drebbel على خطة متعددة الخطوات نُشرت في مبنى الشركة في 6 يناير المُنقضي وتتضمن مراجعة كاملة لخوارزميات التوصية.

وفي مارس الماضي نشرت مجموعة “Drebbel” عن تقدمها في الدراسة واقترحت طريقة للمضي قدما. وكتبوا أنه “إذا تمكَّن الباحثون من تحديد المجموعات التي تغذي مجتمعات مكافحة التطعيم و Qanon”” بشكل منهجي، فلربما يمكن أن يضع “فيسبوك” عقبات في الطرق لمنع الناس من السقوط في “حفر الأرانب”.

أكثر تطرفاً

بحثت دراسات “Drebbel” في مجموعة “Qanon” والمجموعات المضادة للقاحات التي تمت إزالتها لانتهاكها السياسات المتعلقة بالتضليل والعنف والتحريض، وحددت “Drebbel” (5931 ) مجموعة Qanon”” تضم 2.2 مليون عضو، نصفها انضم من خلال ما يسمى مجموعات البوابات.Gateway” “groups.

كما حددت ( 913) مجموعة مناهضة للتلقيح تضم 1.7 مليون عضوا، وخلصت إلى أن مليونًا قد انضموا إليها عبر مجموعات البوابة. (قال “فيسبوك” إنه يدرك الحاجة إلى فعل المزيد).

وحذر موظفو النزاهة على “فيسبوك” في تقرير سابق من أن المجموعات المناهضة للقاحات يمكن أن تصبح أكثر تطرفا.

وقال التقرير “نتوقع أن نرى جسرا بين العالم على الإنترنت وخارجه.. وقد نرى المستخدمين المتحمسين ينشئون مجتمعات فرعية مع مستخدمين آخرين متحمسين للغاية للتخطيط للعمل لوقف التطعيم”.

أفادت مجموعة منفصلة عبر الأقسام هذا العام أن التردد حيال اللقاح في الولايات المتحدة “يشبه إلى حد بعيد” حركات متطرفة مثل Qanon”” و “”Stop the Steal.

قوة المجتمعات

وقالوا ” لقد وجدنا –مثل العديد من المشكلات في “فيسبوك”– أنَّ هذه مشكلة ثقيلة مع عدد قليل نسبيا من الممثلين الذين ينشئون نسبة كبيرة من المحتوى والنمو”.

وقال المتحدث باسم فيسبوك إنَّ الشركة “ركزت على النتائج” فيما يتعلق بـ كوفيد-19 وأنَّها شهدت انخفاضا في تردد تلقي اللقاح بنسبة 50 بالمائة، وفقًا لمسح أجرته مع جامعة “كارنيجي ميلون” وجامعة “ماريلاند”.

يبقى أن نرى ما إذا كانت أحدث مبادرات النزاهة على “فيسبوك” ستكون قادرة على إيقاف حركة نظرية المؤامرة الخطيرة التالية أو التنظيم العنيف للحركات الحالية، لكن توصيات سياستهم قد يكون لها وزن أكبر الآن بعد أن كشف العنف في 6 يناير الماضي، عن التأثير الهائل والأخطار التي من الممكن أن تحدثها حتى أصغر المجتمعات المتطرفة والمعلومات المضللة التي تغذيها.

وخلص التقرير الصادر في عام 2021 إلى أن “قوة المجتمع عندما تستند إلى مواضيع أو أيديولوجيات ضارة، فإنه من المحتمل أن تشكل تهديدا أكبر لمستخدمينا من أي جزء من المحتوى أو جهة معادية أو شبكة ضارة”.

وقال المتحدث باسم “فيسبوك” إن التوصيات الصادرة عن الدراسات ” تسير على الطريق الصحيح: “هذا عمل مهم ولدينا سجل حافل من استخدام أبحاثنا للإبلاغ عن التغييرات في تطبيقاتنا” وبحسب المتحدث فإن””Drebbel يتوافق مع هذا النهج، وقد ساعدت أبحاثه في تحديد قرارنا هذا العام بالتوقف بشكل دائم عن التوصية بالمجموعات المدنية أو السياسية أو الإخبارية على منصتنا. نحن فخورون بهذا العمل ونتوقع أن يستمر في إثراء قرارات المنتج والسياسة في المستقبل.